Некоторые синтетические поведенческие факторы ранжирования Яндекса.

Если ты воздействуешь на поведенческие факторы естественным или искусственным способом, то данная заметка поможет тебе понять в правильном ли направлении ты двигаешься.

На этот раз почти никакой отсебятины — список синтетических поведенческих факторов опубликован по доброй воле Яндекса в докладе Through-the-Looking Glass: Utilizing Rich Post-Search Trail Statistics for Web Search.

Самим Яндексом статья датируется 1-м сентября 2013 года. Была представлена на конференции CIKM 2013, проходившей с 27 октября по 1 ноября 2013 года в Бёрлингейме (США)

На сайте Яндекса упоминание доклада есть, но самого текста до сих пор нет. Поняли, что сболтнули лишнего? 🙂

NB: Выражаю благодарность Илье Зябреву AlterTrader Research ltd за предоставление текста доклада.

Поведенческие факторы ранжирования Яндекса

QueryDomCTR — среднее значение CTR всех документов домена по данному запросу

QueryUrlCTR — среднее значение CTR конкретного документа по данному запросу.

QDwellTimeDev — стандартное отклонение (девиация) от среднего времени пребывания на документе по запросу. Может применяться для отсеивания накруток ПФ.

QDwellTime — этот параметр в докладе не упоминается, но он очевидно используется как фактор ранжирования . Т.к. если мы считаем стандартное отклонение для случайной величины, то должны знать и матожидание (оно же среднее значение) этой величины. Соответственно это среднее время пребывания посетителя на документе по запросу.

AvSatSteps — среднее количество удовлетворённых шагов по сайту. Удовлетворённый шаг — переход по внутренней ссылке после 30 секунд пребывания на документе. Важно, что среднее значение таких шагов всего ~0.2 и меньше на домен не зависимо от тематики сайта.

NB: Как следует из данного доклада Яндекс «знает» к какой тематике принадлежит страница сайта. На основании собственного набора доменов второго уровня с вручную определёнными тематиками (я так понимаю это ни что иное как Я.Каталог, возможно расширенный за счёт Dmoz.org) и c помощью наивного байесовского классификатора любой документ из индекса приписывается к той или иной тематике.

AvDwellTime — общее среднее время пребывания посетителя на документе по разным поисковым запросам.

DwellTimeDev — стандартное отклонение (девиация) времени пребывания на сайте. Так же может использоваться для отслеживания накруток ПФ.

90thDwellTime — это верхний дециль, он же 90-й персентиль среднего времени пребывания на сайте. Позволяет отбрасывать накрученные AvDwellTime и QDwellTime.

10thDwellTime — это нижний дециль среднего времени пребывания на сайте. Позволяет определять дорвеи. Очевидно, что Яндекс ожидает от «белых» вебмастеров улучшений именно тут.

TimeOnDomain — общее время пребывания на сайте. По всем запросам любых документов.

CumulativeDev — стандартное отклонение (девиация) от среднего времени пребывания на сайте

Несколько ехидных замечаний

- Ты боишься, что накрутка ПФ снижает конверсию и это негативно влияет на ранжирование? Не гневи SEO-бога — Яндекс умеет считать только satisfied steps. О конверсии он даже не помышляет. Я уже пытался объяснить почему.

- Чтобы удовлетворить инженеров Яндекса тебе следует крупные статьи разбивать на маленькие. Очень маленькие. Потому что средний человек читает менее 300 слов в минуту. А инженеров интересует клик через 30 секунд. К этому моменту ты прочитал уже примерно 300 слов в этой небольшой заметке. Для сравнения, хорошей обзорной статьёй считается заметка длинной минимум в 1000 слов.

- По той же причине тебе не следует размещать ни внутренних, ни тем более внешних ссылок в начале документа. Чтобы не было неудовлетворённых переходов.

Вместо заключения

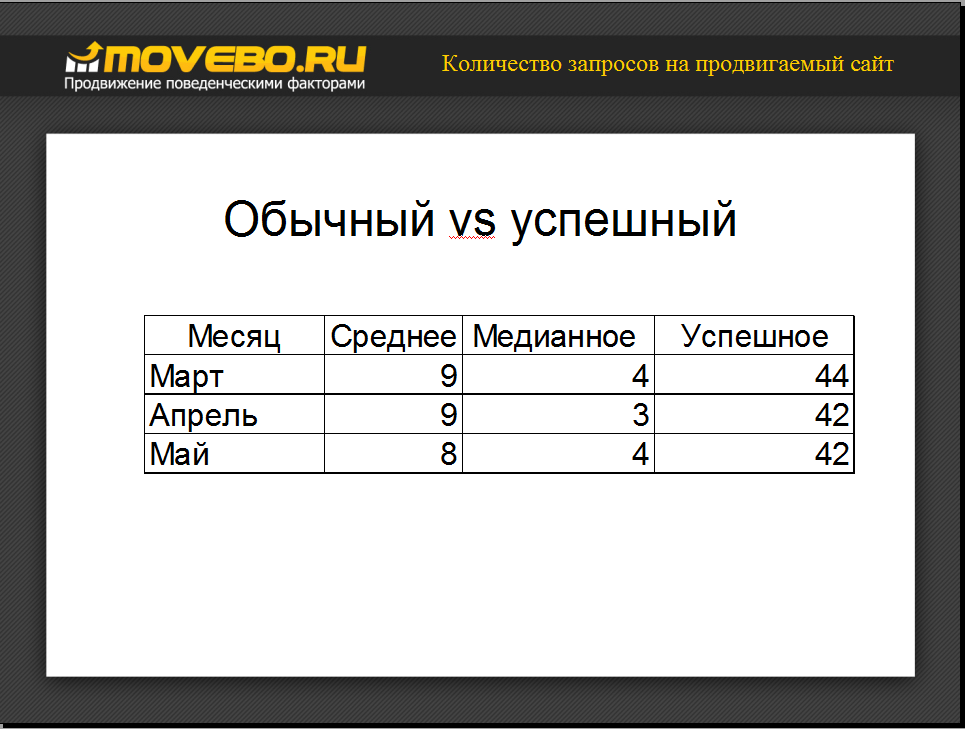

Данный доклад Яндекса замечательно объясняет, почему не работает накрутка поведенческих факторов ранжирования по 3-4 запросам. А именно такое количество запросов пытается накручивать обычный (медианный) оптимизатор. Средний — всего 9. Успешный же оптимизатор накручивает в среднем от 40 запросов и выше. Только так можно заметно повлиять например на AvDwellTime и TimeOnDomain.

Эти данные я приводил в июне 2013 года на конференции по конверсии. Но тот доклад видимо было воспринят исключительно как реклама сервиса.

http://www.youtube.com/watch?v=qy61DRegtN0

Непосредственно о ПФ я сбивчиво и путано бормочу с 15:44. Из этого же видео можно узнать о чём я собирался рассказывать в III части списка ПФ. Которую я как-нибудь всё-таки изложу и в письменном виде 🙂

Как теперь стало понятно, инженеров из Яндекса я переоценил — работа над улучшением конверсии снижает количество удовлетворённых шагов, но мужики-то об этом не знают (ц)!

А что ты думаешь о засвеченных в докладе Яндекса поведенческих факторах и естественных или не очень способах воздействия на них?